هوش مصنوعی و پیشرفتهای مداوم آن را نمیتوان با عبارت صرف «فناوری نوظهور» توضیح داد. AI به پدیدهای تبدیل شده که آینده ما در دستان این ساخته بشری هست و آن را تغییر خواهد داد. تغییرات ناشی از هوش مصنوعی ترکیبی از مزایا و خطرات است که با شناسایی آنها میتوانیم مسیر مناسبتری را برای مواجهه با آن انتخاب کنیم.

این متن خلاصهای ویرایش شده از مقالهی اخیر هاروارد دیتاساینس ریویو است که با عنوان «گفتگوی متخصصان علوم داده درباره خطرات و فرصتهای هوش مصنوعی» منتشر شده است.این نشریه، وبیناری مجازی در مورد خطرات و مزایای سیستمهای هوش مصنوعی با حضور متخصصان این حوزه، دیوید بنکس (متخصص آمار و دبیر وبینار)، ژرارد دو ملو (استاد علوم داده و هوش مصنوعی)، سام (شینوی) گونگ (متخصص داده)، یونگچان کوان (استاد آمار در دانشگاه کلمبیا) و سینتیا رودین (متخصص داده) برگزار کرده و نتایج آن را در قالب یک مقاله، در شماره سوم از سری ششم آن منتشر کرده است.

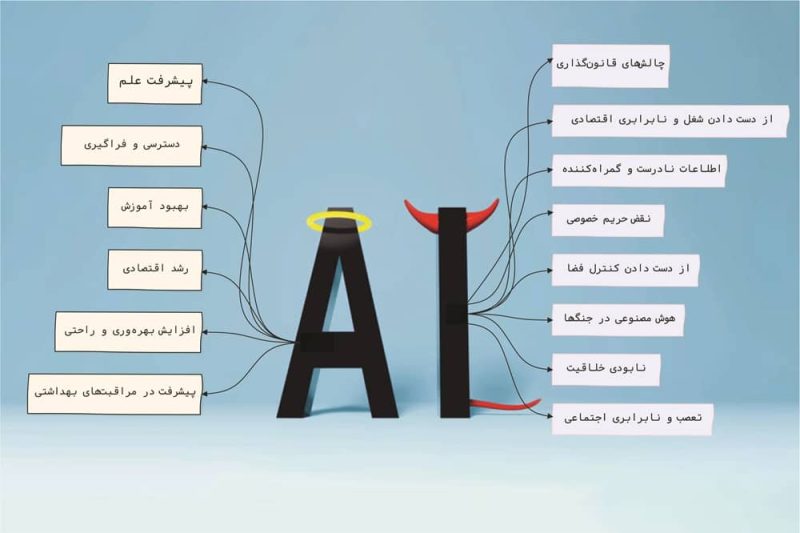

مزایا و خطرات هوش مصنوعی؛ یک بررسی دقیق

تحولات سریع هوش مصنوعی نه تنها فرصتهای بزرگی را به همراه دارد، بلکه چالشهای پیچیدهای را نیز به وجود آورده است. در ادامه متن مزایا و خطراتی که هوش مصنوعی پیشروی جامعه میگذارد آورده شده است؛

مزایا

- پیشرفت علم

مشخصترین ویژگی هوش مصنوعی که هیچ شکی در آن نیست، تحول انقلابی در حوزههای علمی است و پیشرفتهای بزرگی در زمینههایی مانند علم مواد، پزشکی، فیزیک، شیمی و زیستشناسی به ارمغان بیاورد. برای مثال میتوان به هوش مصنوعی AlphaFold اشاره کرد؛ پیش از این شناسایی ساختار پروتئینها بسیار سخت بود و AlphaFold توانسته دستاوردهای بزرگی در پیشبینی ساختار پروتئینها داشته باشد و این پیشرفت نویدبخش کشف داروهای جدید و اثربخش و درک بهتر بیماریهاست.

- بهبود آموزش

هوش مصنوعی این توانایی را دارد که تجربه آموزشی را شخصیسازی کند و آموزش را برای دانشآموزان و معلمان کارآمدتر و مؤثرتر کند. ابزارهایی مانند ChatGPT میتوانند به دانشآموزان در حل مشکلات، مانند کمک به حل مسائل و دیباگ کردن کدها، خدمات فوری و همیشه در دسترس ارائه کنند و در نتیجه وقت معلمان برای بهبود روشهای تدریس و توجه به دانشآموزان بیشتر آزاد شود.

- پیشرفت در مراقبتهای بهداشتی

در حوزه بهداشت و درمان، پیشرفتهای امیدوارکنندهای در زمینههایی مانند پزشکی، تشخیص بیماریها و توسعه داروها به همراه داشته و دارد. الگوریتمهای هوش مصنوعی میتوانند دادههای بزرگ پزشکی را تجزیه و تحلیل کرده و الگوها و نشانههای بالقوهای را که ممکن است توسط پزشکان انسانی نادیده گرفته شوند، شناسایی کنند و به این ترتیب منجر به تشخیصهای دقیقتر و زودتر شوند.

- افزایش بهرهوری و راحتی

اتوماسیون مبتنی بر هوش مصنوعی میتواند وظایف را ساده کند و باعث افزایش چشمگیر بهرهوری و راحتی در صنایع مختلف شود. از دستیاران شخصی مبتنی بر هوش مصنوعی که برنامهریزیها و قرارها را مدیریت میکنند تا مرکز امور مشتریان خودکار که پرسشها را بهطور مؤثر پاسخ میدهند، این فناوری میتواند زمان و منابع انسانی را برای فعالیتهای پیچیده و خلاقانهتر آزاد کند. خودروهای خودران نیز که در آینده به طور کامل عملیاتی خواهند شد، پتانسیل آن را دارند که حملونقل را ایمنتر و کارآمدتر کنند.

- دسترسی و فراگیری

هوش مصنوعی میتواند موانع ارتباطی را از بین ببرد یا آنها را تسهیل کند؛ به افراد دارای ناتوانی کمک کند و راههای جدیدی برای بیان خلاقانه ایجاد کند. به عنوان مثال، هوش مصنوعی میتواند ترجمه زنده زبان را تسهیل کند و ارتباطات بین زبانهای مختلف را آسانتر کند. فناوریهای کمکی مبتنی بر هوش مصنوعی میتوانند با ارائه حمایتهای شخصیسازیشده، زندگی افراد دارای ناتوانی را بهبود بخشند.

- رشد اقتصادی

در حالی که نگرانیهای منطقی در مورد از دست دادن شغلها وجود دارد، نظراتی هم هست که افزایش بهرهوری توسط هوش مصنوعی پتانسیل رشد اقتصادی را دارد و میتواند راه را برای مدلهای اقتصادی جایگزین مانند درآمد پایه همگانی (UBI) هموار کند. ایده این است که با بهعهده گرفتن بخش بزرگتری از کارها توسط هوش مصنوعی، جوامع میتوانند ثروت بیشتری تولید کنند و امکان اجرای UBI را فراهم کنند تا همه از این پیشرفتها بهرهمند شوند.

خطرات

- اطلاعات نادرست و گمراهکننده

توانایی هوش مصنوعی در تولید و انتشار اطلاعات نادرست در مقیاس بیسابقه، یک خطر جدی بهشمار میرود. این قابلیت میتواند برای دستکاری افکار عمومی، ایجاد ناآرامیهای اجتماعی و حتی دامن زدن به درگیریهای بینالمللی مورد استفاده قرار گیرد. میتوان به مواردی مانند گسترش اخبار جعلی در رسانههای اجتماعی و استفاده از تکنیکهای deepfake اشاره کرد که باعث تفرقه و بیاعتمادی میشود.

- تعصب و نابرابری اجتماعی

نگرانی عمده دیگر این است که سیستمهای هوش مصنوعی ممکن است تعصبات اجتماعی موجود در دادههایی که روی آنها آموزش دیدهاند را به ارث ببرند و حتی تقویت کنند. این مسئله در حوزههای حساس مانند استخدام، مراقبتهای بهداشتی و نظارت بر محتوا بسیار نگرانکننده است، جایی که الگوریتمهای متعصب میتوانند نتایج ناعادلانه یا تبعیضآمیز ایجاد کنند. برای مثال، اگر یک سیستم استخدام مبتنی بر هوش مصنوعی با دادههایی آموزش دیده باشد که تعصب جنسیتی در برخی مشاغل را نشان میدهد، ممکن است، ناعادلانه نسبت به زنان داوطلب رأی دهد.

- نقض حریم خصوصی

استفاده گسترده از فناوریهایی مانند تشخیص چهره و جمعآوری دادههای بیومتریک باعث نگرانیهای جدی در مورد نقض حریم خصوصی شده است. این فناوریها میتوانند برای نظارت گسترده، پروفایلسازی غیرمجاز و اشکال دیگر از تجاوز به آزادیهای فردی استفاده شوند.میتوان به مواردی اشاره مانند فناوری تشخیص چهره نادرستی که منجر به دستگیریهای اشتباه شده اشاره کرد.

- از دست دادن شغل و نابرابری اقتصادی

خطر قابل توجه جایگزینی کارگران توسط اتوماسیون مبتنی بر هوش مصنوعی در بخشهای مختلف است که ممکن است منجر به از دست دادن شغلهای گسترده و تشدید نابرابری اقتصادی شود. این نگرانی نه تنها شامل رانندگان کامیون یا تاکسی میشود، بلکه به حوزههایی مانند نویسندگی، هنر و خدمات مشتری نیز گسترش یافته است که هوش مصنوعی در آنها نیز مهارت بیشتری از خود نشان میدهد.

- اتکای بیش از حد و از دست دادن کنترل

با پیچیدهتر و خودمختارتر شدن سیستمهای هوش مصنوعی، خطر اتکای بیش از حد به خروجیهای آنها بدون درک یا نظارت کافی وجود دارد. این امر میتواند منجر به عدم شفافیت در فرآیندهای تصمیمگیری شود و مشکلاتی در تعیین مسئولیت به وجود آورد.

- نابودی خلاقیت

در حالی که هوش مصنوعی میتواند در وظایف خلاقانه کمک کند، خطر این وجود دارد که خروجیهای آن یکسان و فاقد تنوع و اصالت باشند. این مسئله در تولید تصاویر و متون توسط هوش مصنوعی مشهود است که اگر چه فنی هستند اما اغلب تکراری به نظر میرسند.

- هوش مصنوعی در جنگ

توسعه سیستمهای تسلیحاتی مبتنی بر هوش مصنوعی نگرانیهای اخلاقی جدی ایجاد میکند. اسلحههای خودمختار که قادر به تصمیمگیری در مورد زندگی و مرگ بدون دخالت انسان هستند، خطرات بزرگی به همراه دارند.

- چالشهای مربوط به قانونگذاری

سرعت سریع پیشرفت هوش مصنوعی چالشی بزرگ برای قانونگذاران است. تعیین میزان مناسب قانونگذاری، یافتن توازن بین ایمنی و پیشرفت و حل مسائل مربوط به مسئولیت و پاسخگویی همچنان چالشهای مهمی هستند که به راهحلهای دقیق و انعطافپذیر نیاز دارند.

خوب چه کار کنیم؟

متخصصان مهمان وبینار معتقدند که برای بهره بردن از مزایای هوش مصنوعی مستلزم یافتن راهها و انجام اقداماتی برای کاهش فعالانه مضرات بالقوه آن هستیم؛

مقررات

- دامنه فعالیت: متخصصان بر لزوم نظارت دولتی، بهویژه در حوزههای پرخطر مانند جنگافزارها، خودروهای خودران، و پایگاههای داده بزرگ بیومتریک تأکید دارند. این شامل در نظر گرفتن مقررات برای بازارهای داده است که در آن دادههای شخصی بدون رضایت صریح یا جبران مناسب خرید و فروش میشوند.

- الزامات شفافیت: الزام به برچسبگذاری واضح محتوای تولید شده توسط هوش مصنوعی.

- قوانین کپیرایت: بهروزرسانی قوانین کپیرایت برای محافظت از آثاری که مدلهای هوش مصنوعی از آنها برای تولید محتوای جدید استفاده میکند.

- اجرای قوانین انحصارزدایی: استفاده از قوانین موجود برای جلوگیری از سوءاستفاده از سوی تعداد محدودی از سیستمهای هوش مصنوعی که بازارها و دادهها را تحت کنترل دارند.

البته برای نظارت بر حوزهای مانند هوش مصنوعی که بهسرعت در حال تحول است، چالشهای زیادی وجود دارد و نیازمند همگامی آن با پیشرفتهای جدید و تضمین انعطافپذیری مقررات در این حوزه است.

شفافیت و تفسیرپذیری

- پرداختن به مسئله جعبه سیاه هوش مصنوعی: سیستمهای هوش مصنوعی که فرآیند تصمیمگیری در آنها نامشخص است، ارزیابی مسئولیتپذیری، اطمینان از انصاف، و ایجاد اعتماد را دشوار میکنند.

- تشویق به تفسیرپذیری: متخصصان از توسعه مدلهای هوش مصنوعی قابل تفسیر حمایت میکنند که انسانها بتوانند منطق پشت تصمیمات آنها را درک کنند.

- شناخت فرآیندهای آموزش: مقررات میتواند نیاز به شناخت جزئیات فرآیندهای آموزش مدلهای هوش مصنوعی، شامل دادههای استفادهشده، منابع آنها، معماری مدل و پارامترهای بهینهسازی را الزامی کند.

دستورالعملها و کدهای اخلاقی

- توجه پیشگیرانه: متخصصان بر توسعه و اجرای مداوم دستورالعملهای اخلاقی در تمام مراحل توسعه و استفاده از هوش مصنوعی تأکید دارند.

- همسویی و انصاف: تمرکز اصلی باید بر اطمینان از همسویی هوش مصنوعی با ارزشهای انسانی و کاهش تعصبات باشد.

- تعریف معیارهای انصاف: این شامل تعیین تعاریف روشن و مورد توافق از انصاف در هوش مصنوعی است، با در نظر گرفتن این که ممکن است تعاریف مختلفی وجود داشته باشد و نیاز به مصالحه باشد.

- مقابله با تعصبات الگوریتمی: سیستمهای هوش مصنوعی باید طوری طراحی و آموزش داده شوند که از تقویت تعصبات اجتماعی موجود جلوگیری کنند و بهویژه در حوزههایی مانند استخدام، مراقبتهای بهداشتی و نظارت بر محتوا آن را به حداقل برسانند.

- انصاف متقابل: در نظارت بر محتوا، این به معنای اجرای قوانین بهصورت یکسان برای همه گروهها است. برای مثال، اگر یک پلتفرم، پستی را برای گفتن «گروه X بیماری Y را گسترش میدهد» حذف کند، باید به طور مشابه پستهای مشابهی را هم که گروههای دیگر را هدف قرار میدهند حذف کند.

همکاری:

- رویکرد چندرشتهای: متخصصان تأکید دارند که برای مدیریت موفقیتآمیز چالشهای اخلاقی، اجتماعی و اقتصادی هوش مصنوعی، همکاری بین ذینفعان ضروری است، از جمله:

- متخصصان علوم داده: با ارائه تخصص فنی، توسعه مدلهای شفافتر و قابل تفسیرتر و کمک به اندازهگیری و کاهش تعصبات هوش مصنوعی.

- سیاستگذاران: با ایجاد و اجرای چارچوبهای نظارتی مؤثر برای توسعه و استقرار هوش مصنوعی.

- اخلاقدانان: با هدایت توسعه و استفاده اخلاقی از هوش مصنوعی و اطمینان از همسویی آن با ارزشهای انسانی.

- عموم مردم: با مشارکت در بحثهای آگاهانه درباره تأثیرات هوش مصنوعی و کمک به توسعه شیوههای مسئولانه در این حوزه.

اقدامات پیشگیرانه، از جمله مقررات، شفافیت، دستورالعملهای اخلاقی و همکاری تمامی ذینفعان، برای کاهش خطرات هوش مصنوعی و بهرهبرداری کامل از پتانسیل آن به نفع جامعه ضروری است.

جمعبندی

پیشرفت سریع هوش مصنوعی، آیندههای متفاوتی را میتواند برای ما رقم بزند. از یک سو، این فناوری پتانسیل چشمگیری برای پیشرفت علمی و رشد اقتصادی دارد، اما از سوی دیگر، بدون اقدامات پیشگیرانه مناسب میتواند به تشدید نابرابریها، نقض حریم خصوصی و سوءاستفادههای مخرب بینجامد. سرعت بیسابقه توسعه هوش مصنوعی، نیازمند اقدام فوری برای تنظیم مقررات و دستورالعملهای اخلاقی است، زیرا تعلل میتواند پیامدهای جبرانناپذیری به همراه داشته باشد.

حل چالشهای هوش مصنوعی نیازمند همکاری گسترده میان متخصصان حوزههای مختلف، از متخصصان علوم داده گرفته تا اخلاقدانان و سیاستگذاران است. شفافیت در عملکرد سیستمها، مقابله با تعصبات موجود در دادهها، و اطمینان از مسئولیتپذیری، ضروریاتی هستند که باید مورد توجه قرار گیرند. با اتخاذ رویکردی پیشگیرانه و اولویت دادن به ملاحظات اخلاقی، میتوانیم از قدرت تحولآفرین هوش مصنوعی به نفع کل بشریت بهره ببریم.

این یادداشت یک پیام مشخص دارد: همگام با بهرهگیری از تواناییهای هوش مصنوعی، باید مراقب خطرات آن نیز باشیم و با هوشیاری برای ایجاد چارچوبهای لازم جهت استفاده مسئولانه از این فناوری تلاش کنیم.